En rekke selskaper inkludert Microsoft і Facebook, og til og med forskere fra University of Southern California, utvikler teknologier for å bekjempe dype forfalskninger og forhindre at de spres av gule medier og feilinformasjon generelt. Imidlertid klarte en gruppe forskere fortsatt å lure dem.

Et team av informatikere ved University of California, San Diego advarte om at det fortsatt er mulig å lure eksisterende deepfake-deteksjonssystemer ved å sette inn inputdata kalt "konkurrerende eksempler" i hver videoramme. Forskerne presenterte funnene sine på WACV 2021 Computer Vision Conference, som ble holdt online forrige måned.

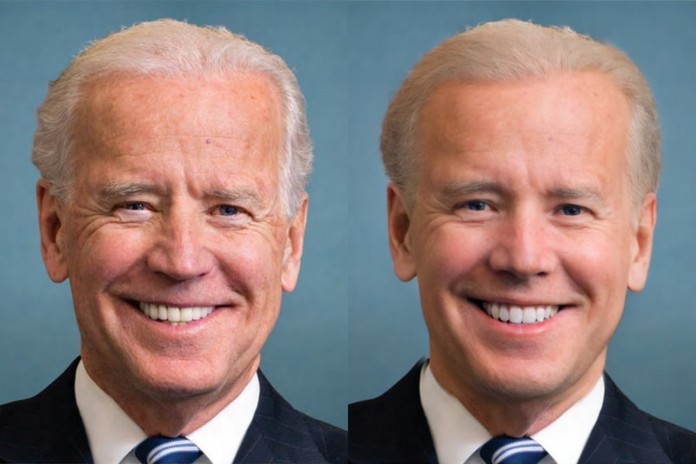

Konkurrerende eksempler er litt endrede innganger som får kunstige intelligenssystemer, for eksempel maskinlæringsmodeller, til å gjøre feil. I tillegg viste teamet at angrepet fortsatt fungerer etter å ha komprimert videoen. I videoen ovenfor viser forskerne at XceptionNet, en deepfake-detektor, stempler deres konkurrerende video som «ekte».

De fleste av disse detektorene fungerer ved å spore ansikter i en video og sende de beskårne ansiktsdataene til et nevralt nettverk for analyse. Det nevrale nettverket vil deretter analysere disse dataene og finne elementer som vanligvis er dårlig gjengitt i dype forfalskninger, for eksempel flimring.

Ved å sette inn konkurrerende eksempler fant forskerne ut at de kunne lure disse dypfalske detektorene til å tro at videoene var ekte.

De uttaler i avisen at «for å bruke disse dypfalske detektorene i praksis, er det viktig å evaluere dem mot en adaptiv motstander som er klar over denne beskyttelsen og bevisst prøver å bryte den. Vi viser at moderne deepfake-deteksjonsmetoder lett kan omgås hvis angriperen er helt eller delvis klar over detektoren."

Som disse forskerne har vist, kan det hende at automatiseringsteknologiene som utvikles for å bekjempe desinformasjon ennå ikke er opp til oppgaven.

Les også: